В современной философии есть несколько концепций того, как определить сознание. Одна из них опирается на тест Тьюринга, вокруг которого много споров.

Время чтения: 2 минуты

Приложение для саморазвития. Скачать

Тест Тьюринга

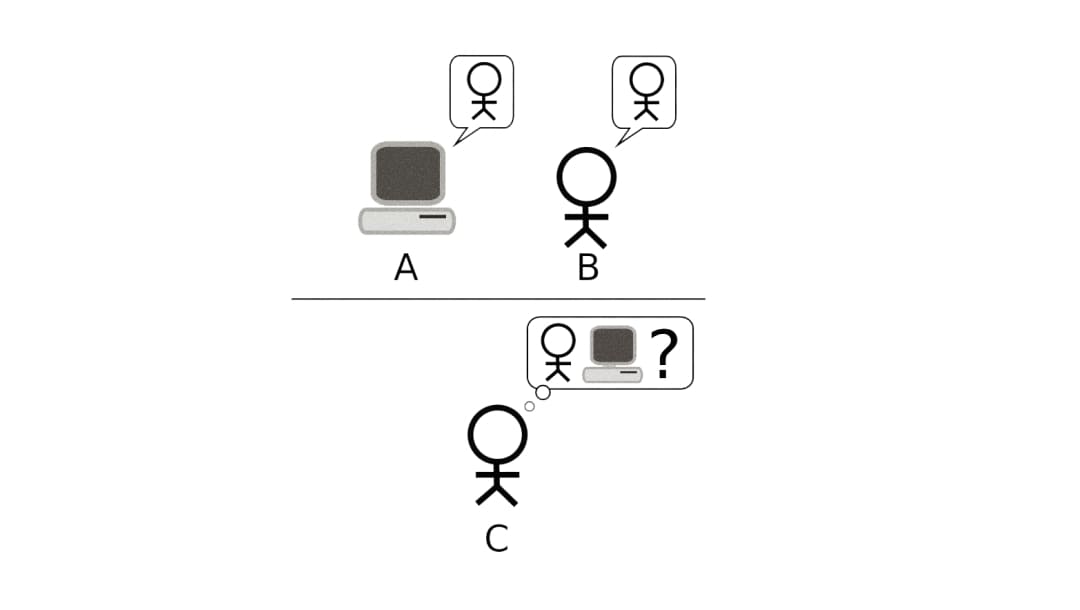

Этот тест является одним из самых авторитетных экспериментов в философии сознания. Его цель — выяснить, способна ли машина мыслить. Тест проходит очень просто: человек через экран и клавиатуру общается с компьютером и человеком. Если человек не в состоянии определить, кто их них кто, то машина прошла тест.

Задача машины — имитировать общение так, чтобы человек ничего не заподозрил. Это будет говорить о возникновении мыслительной деятельности у машины. Но действительно ли игра в имитацию человеческого диалога свидетельствует о наличии сознания у машины?

Опровержение

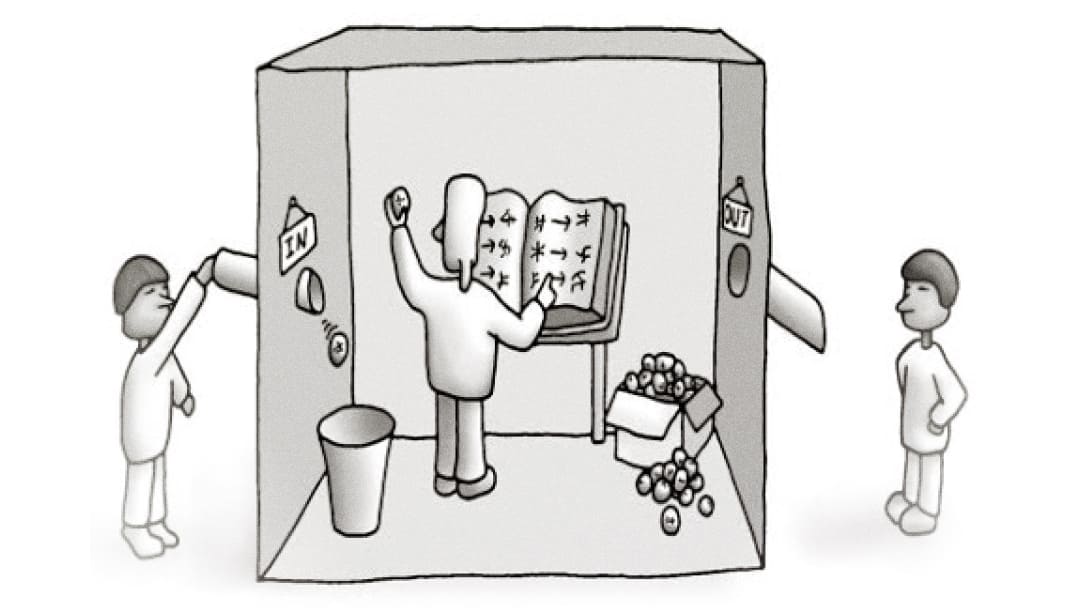

Его выдвинул философ сознания Джон Серль. Свой главный критический аргумент он изобразил в эксперименте «Китайская комната». Суть его такова: человека, знающего только английский, поместили в закрытую комнату и дали специальную инструкцию, где соотнесены китайские иероглифы с буквами английского алфавита.

Через одно окно ему поступает письменное высказывание на китайском, и он с помощью инструкции механически подбирает правильный ответ и передаёт его через другое окно.

Ему могут задать любой вопрос, например, «Что такое Солнце?», и получить адекватный ответ «Солнце — это звезда». Таким образом, люди, находящиеся вне комнаты, делают вывод, что человек внутри комнаты понимает китайский. Но в чём здесь проблема?

Аргумент «Китайской комнаты» направлен против той теории сознания, которая говорит, что можно просто воссоздать функции сознательной деятельности и тем самым создать мыслящую машину. Но человек в «Китайской комнате» знает только последовательность знаков, он их не понимает.

Так и в тесте Тьюринга мы можем думать, что по другую сторону сидит человек, хотя машина просто грамотно комбинировала между собой слова, не понимая их смысла.

Эксперимент показывает, что испытуемый понимает только синтаксис, то есть соединение слов между собой. Но не семантику, то есть смысл и значение слов китайского языка. Таким образом, делает вывод Серль, успешное прохождение теста Тьюринга говорит только о том, что машина научилась правильно соотносить языковые конструкции, но она их не понимает. Соответственно, и о разумности такой машины говорить нельзя.

Сознание — одна из самых сложных тем философии, в которой с каждым годом споров и противоречий становится только больше. От однозначного понимания сознания мы всё ещё очень далеки, несмотря на достижения философии сознания, нейролингвистики и когнитивной науки.